تا چند سال گذشته، OpenAI انگار یک برند تکنفره بود. سم آلتمن، مدیرعامل شرکت، با سبک نمایشی و زرق و برقش در جذب سرمایه، همه اسمهای بزرگ دیگه شرکت رو زیر سایه خودش قرار داده بود. حتی ماجرای اخراج ناموفقش هم در نهایت با برگشتن اون به راس شرکت و مشهورتر شدنش تموم شد. اما اگه از این چهره کاریزماتیک عبور کنیم، تصویر واضحتری از مسیر آینده این شرکت به دست میاریم. به هر حال، این آلتمن نیست که داره فناوریای رو میسازه که اعتبار شرکت به اون بستگی داره.

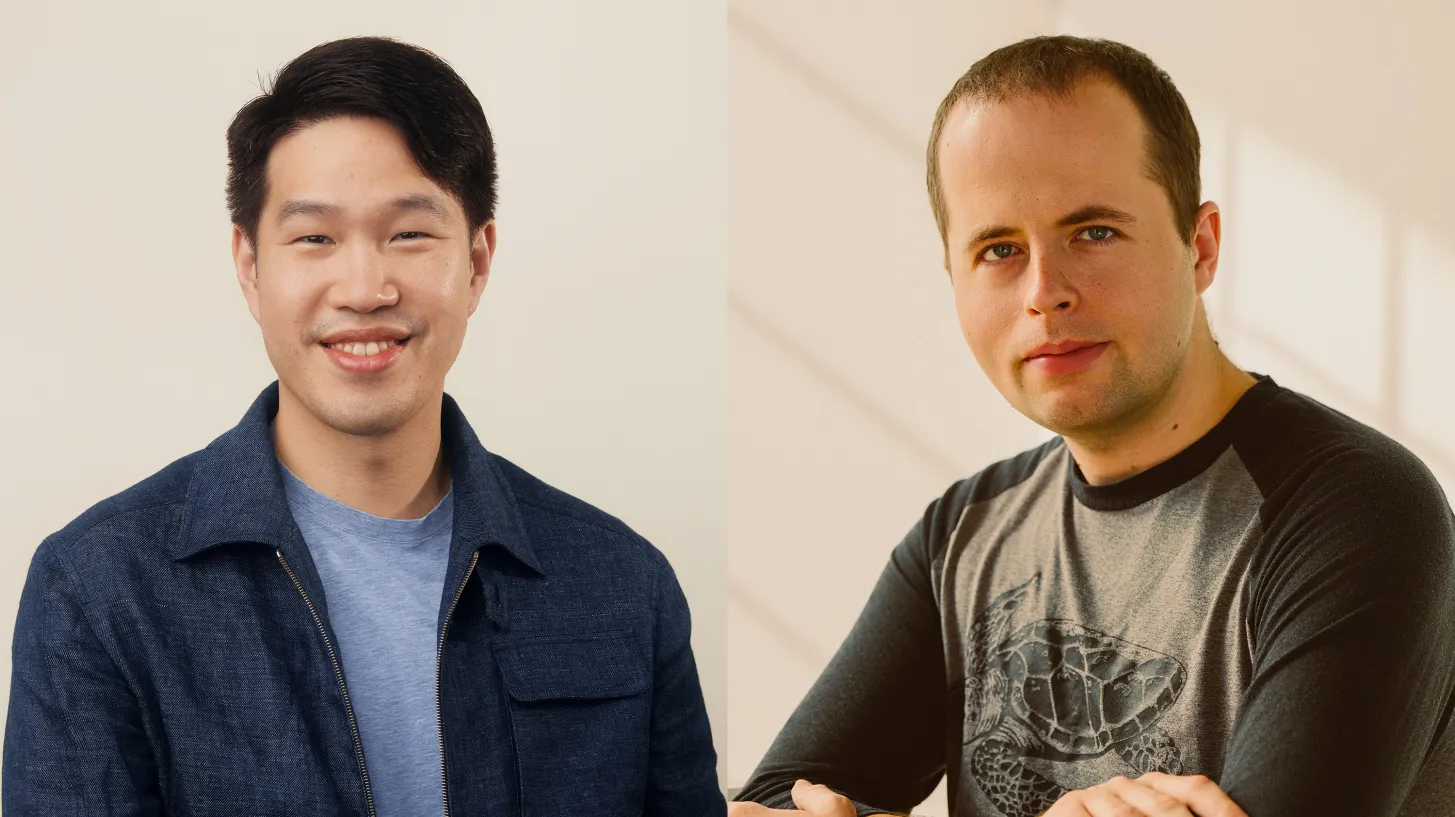

این مسئولیت بر عهده دو مدیر پژوهشی OpenAI یعنی مارک چن، مدیر ارشد پژوهشی، و یاکوب پاچوکی، دانشمند ارشد، قرار داره. این دو نفر با هم وظیفه دارن که مطمئن بشن OpenAI همیشه یک قدم از رقبای قدرتمندی مثل گوگل جلوتره.

در سفر اخیر این دو نفر به لندن، جایی که OpenAI اولین دفتر بینالمللی خودش رو در سال ۲۰۲۳ تاسیس کرد، یک گفتگوی اختصاصی با اونها انجام شد. در این گفتگو، درباره این صحبت شد که چطور تنش ذاتی بین پژوهش و محصول رو مدیریت میکنن؛ چرا فکر میکنن کدنویسی و ریاضیات کلید رسیدن به مدلهای همهکاره و تواناتره؛ وقتی از هوش مصنوعی عمومی (AGI) حرف میزنن دقیقا منظورشون چیه؛ و چه اتفاقی برای تیم «ابرهمراستاسازی» (superalignment) افتاد، تیمی که توسط ایلیا سوتسکور، همبنیانگذار و دانشمند ارشد سابق شرکت، برای جلوگیری از سرکش شدن یک ابرهوش فرضی تاسیس شده بود و کمی بعد از رفتن اون منحل شد.

به طور مشخص، هدف این بود که بفهمیم ذهنیت این دو نفر در آستانه بزرگترین عرضه محصول OpenAI در ماههای اخیر، یعنی GPT-5، چطوره.

گزارشهایی منتشر شده که میگه مدل نسل بعدی این شرکت در ماه آگوست عرضه میشه. موضع رسمی OpenAI، یا بهتر بگیم موضع آلتمن، اینه که GPT-5 «به زودی» منتشر خواهد شد. انتظارات خیلی بالاست. جهشهایی که OpenAI با GPT-3 و بعد GPT-4 داشت، سطح انتظارات از تواناییهای این فناوری رو به شدت بالا برد. با این حال، تاخیر در عرضه GPT-5 به شایعاتی دامن زده که میگن OpenAI در ساخت مدلی که بتونه انتظارات خودش، و البته بقیه، رو برآورده کنه به مشکل خورده.

اما مدیریت انتظارات بخشی از کار شرکتیه که در چند سال گذشته، برنامه کاری کل این صنعت رو مشخص کرده. و در داخل OpenAI، این چن و پاچوکی هستن که این برنامه رو تعیین میکنن.

دو قله

دفتر اصلی شرکت در لندن در پارک سنت جیمز، چند صد متر اونطرفتر از کاخ باکینگهام قرار داره. اما محل ملاقات با چن و پاچوکی در یک اتاق کنفرانس در یک فضای کار اشتراکی نزدیک کینگز کراس بود، جایی که OpenAI به عنوان یک پایگاه دوم در قلب محله فناوری لندن (جایی که گوگل دیپمایند و متا هم دفتر دارن) نگه داشته. لورانس فاکونه، مدیر ارتباطات پژوهشی OpenAI، با یک لپتاپ باز در انتهای میز نشسته بود.

چن، که یک پولو شرت زرشکی پوشیده بود، ظاهری مرتب و تقریبا شیکپوش داره. اون برای مصاحبه با رسانهها آموزش دیده و در گفتگو با خبرنگار راحته. (همون کسی که در ویدیوی معرفی GPT-4o با یک چتبات شوخی میکنه.) پاچوکی، با یک تیشرت مشکی با لوگوی فیل، بیشتر شبیه هکرهای توی فیلمهاست. وقتی حرف میزنه، خیلی به دستهاش نگاه میکنه.

اما این دو نفر خیلی هماهنگتر از چیزی هستن که در نگاه اول به نظر میاد. پاچوکی نقشهاشون رو اینطور خلاصه کرد. اون گفت که چن تیمهای پژوهشی رو شکل میده و مدیریت میکنه. «من مسئول تعیین نقشه راه پژوهشی و پایهریزی دیدگاه فنی بلندمدت ما هستم.»

چن اضافه کرد: «اما این نقشها شناورن. ما هر دو پژوهشگریم و رشتههای فنی رو دنبال میکنیم. هر چیزی که ببینیم میتونیم روش کار کنیم و درستش کنیم، همون کار رو انجام میدیم.»

چن در سال ۲۰۱۸ بعد از کار به عنوان یک معاملهگر کمی در شرکت وال استریتی جین استریت کپیتال، جایی که مدلهای یادگیری ماشین برای معاملات آتی طراحی میکرد، به OpenAI پیوست. در OpenAI اون پیشگام ساخت DALL-E، مدل تولید تصویر انقلابی شرکت، بود. بعد از اون روی اضافه کردن قابلیت تشخیص تصویر به GPT-4 کار کرد و رهبری توسعه Codex، مدل کدنویسی مولدی که پشت GitHub Copilot قرار داره، رو بر عهده داشت.

پاچوکی در سال ۲۰۱۷ یک شغل آکادمیک در علوم کامپیوتر نظری رو رها کرد تا به OpenAI بیاد و در سال ۲۰۲۴ جایگزین سوتسکور به عنوان دانشمند ارشد شد. اون به همراه سوتسکور، یکی از معماران کلیدی مدلهای به اصطلاح «استدلالی» OpenAI، به خصوص o1 و o3، به حساب میاد که برای حل مسائل پیچیده در علوم، ریاضیات و کدنویسی طراحی شدن.

وقتی این ملاقات انجام شد، اونها به خاطر دو پیروزی پشت سر هم برای فناوری شرکتشون حسابی هیجانزده بودن.

در تاریخ ۱۶ جولای، یکی از مدلهای زبان بزرگ OpenAI در فینال تور جهانی AtCoder، یکی از سختترین مسابقات برنامهنویسی جهان، به مقام دوم رسید. در ۱۹ جولای، OpenAI اعلام کرد که یکی از مدلهاش به نتایجی در سطح مدال طلا در المپیاد بینالمللی ریاضی ۲۰۲۵، یکی از معتبرترین مسابقات ریاضی جهان، دست پیدا کرده.

نتیجه ریاضیات سر و صدای زیادی به پا کرد، نه فقط به خاطر دستاورد قابل توجه OpenAI، بلکه به این دلیل که رقیب اونها، گوگل دیپمایند، دو روز بعد اعلام کرد که یکی از مدلهاش در همون مسابقه به همون امتیاز رسیده. گوگل دیپمایند طبق قوانین مسابقه عمل کرده بود و قبل از اعلام عمومی، منتظر مونده بود تا نتایجش توسط برگزارکنندهها تایید بشه؛ در حالی که OpenAI در عمل خودش جوابهاش رو تصحیح کرده بود.

از نظر چن و پاچوکی، نتیجه خودش گویای همه چیزه. به هر حال، این پیروزی در برنامهنویسیه که اونها رو بیشتر هیجانزده کرده. چن گفت: «فکر میکنم این موضوع خیلی دست کم گرفته شده.» اون گفت که کسب مدال طلا در المپیاد بینالمللی ریاضی شما رو جایی بین ۲۰ تا ۵۰ شرکتکننده برتر قرار میده. اما در مسابقه AtCoder مدل OpenAI در بین دو نفر اول قرار گرفت: «اینکه بتونی به یک سطح کاملا متفاوت از عملکرد انسانی برسی، بیسابقه است.»

عرضه، عرضه، عرضه!

آدمهای OpenAI هنوز دوست دارن بگن که در یک آزمایشگاه پژوهشی کار میکنن. اما این شرکت با چیزی که سه سال پیش، قبل از عرضه ChatGPT بود، خیلی فرق کرده. این شرکت الان در حال رقابت با بزرگترین و ثروتمندترین شرکتهای فناوری دنیاست و ۳۰۰ میلیارد دلار ارزشگذاری شده. دیگه پژوهشهای پیشرو و دموهای چشمگیر کافی نیست. باید محصول عرضه کنه و اونها رو به دست مردم برسونه، و این کار رو به خوبی انجام میده.

OpenAI یک روند پیوسته از عرضههای جدید رو حفظ کرده؛ از ارائه بهروزرسانیهای بزرگ برای سری GPT-4 گرفته تا عرضه مدلهای تولید تصویر و ویدیو و معرفی قابلیت صحبت صوتی با ChatGPT. شش ماه پیش، با عرضه o1 و کمی بعد o3، موج جدیدی از مدلهای به اصطلاح استدلالی رو شروع کرد. و هفته گذشته هم عامل (agent) مرورگر خودش به اسم Operator رو به صورت عمومی منتشر کرد. این شرکت الان ادعا میکنه که بیش از ۴۰۰ میلیون نفر هر هفته از محصولاتش استفاده میکنن و روزانه ۲.۵ میلیارد درخواست ثبت میکنن.

فیجی سیمو، مدیرعامل جدید بخش اپلیکیشنهای OpenAI، قصد داره این شتاب رو حفظ کنه. اون در یادداشتی به کارمندان شرکت گفت که مشتاقه «کمک کنه تا فناوریهای OpenAI به دست افراد بیشتری در سراسر جهان برسه» و در اونجا «فرصتهای بیشتری رو برای افراد بیشتری نسبت به هر فناوری دیگهای در تاریخ فراهم کنه.» پس باید منتظر محصولات بیشتری باشیم.

سوال شد که OpenAI چطور پژوهشهای باز و توسعه محصول رو با هم مدیریت میکنه. پاچوکی گفت: «این چیزیه که ما برای مدت خیلی طولانی، خیلی قبل از ChatGPT، بهش فکر میکردیم. اگه ما واقعا در مورد ساختن هوش مصنوعی عمومی جدی باشیم، واضحه که در طول مسیر کارهای زیادی میشه با این فناوری انجام داد و شاخههای زیادی وجود داره که میشه دنبال کرد و به محصولات بزرگی تبدیل میشن.» به عبارت دیگه، درخت رو تکون بده و هرچی میتونی برداشت کن.

یک نکتهای که افراد OpenAI بهش اشاره میکنن اینه که عرضه مدلهای آزمایشی به دنیا، بخش ضروری پژوهش بوده. هدف این بود که مردم رو از اینکه این فناوری چقدر خوب شده آگاه کنن. آلتمن در سال ۲۰۲۲ گفته بود: «ما میخوایم به مردم درباره چیزی که در راهه آموزش بدیم تا بتونیم در گفتگوی اجتماعی خیلی سختی که در پیشه شرکت کنیم.» سازندههای این فناوری جدید و عجیب، همچنین کنجکاو بودن که بدونن این فناوری به چه دردی میخوره: OpenAI مشتاق بود اون رو به دست مردم برسونه تا ببینه باهاش چیکار میکنن.

آیا هنوز هم همینطوره؟ اونها همزمان جواب دادن. چن گفت: «آره!» پاچوکی گفت: «تا حدی.» چن خندید: «نه، شما بگو.»

پاچوکی گفت: «نمیگم پژوهش بر اساس محصول تکرار میشه. اما حالا که مدلها به مرز تواناییهایی رسیدن که با معیارهای کلاسیک قابل اندازهگیری هستن و خیلی از چالشهای قدیمی که بهشون فکر میکردیم دارن حل میشن، به نقطهای رسیدیم که واقعا مسئله اینه که مدلها در دنیای واقعی چه کاری میتونن انجام بدن.»

مثل رقابت با انسانها در مسابقات کدنویسی. کسی که مدل OpenAI رو در مسابقه AtCoder امسال در ژاپن شکست داد، یک برنامهنویس به اسم پشمیسواف دمبیاک بود که با نام سایکو (Psyho) هم شناخته میشه. این مسابقه یک ماراتن حل معما بود که در اون شرکتکنندهها ۱۰ ساعت وقت داشتن تا بهینهترین راه برای حل یک مسئله کدنویسی پیچیده رو پیدا کنن. سایکو بعد از پیروزیش در شبکه اجتماعی ایکس نوشت: «من کاملا خستهام… به سختی زندهام.»

چن و پاچوکی ارتباط نزدیکی با دنیای کدنویسی رقابتی دارن. هر دو در گذشته در مسابقات بینالمللی کدنویسی شرکت کردن و چن مربی تیم المپیاد کامپیوتر آمریکاست. سوال شد که آیا این اشتیاق شخصی به کدنویسی رقابتی، روی تصور اونها از اهمیت عملکرد خوب یک مدل در چنین چالشی تاثیر میذاره.

هر دو خندیدن. پاچوکی گفت: «قطعا. خب، سایکو یک جورایی یک افسانه است. اون سالها نفر اول این مسابقات بوده. اون دوست من هم هست، ما قبلا با هم در این مسابقات رقابت میکردیم.» دمبیاک قبلا با پاچوکی در OpenAI همکار هم بوده.

وقتی پاچوکی در مسابقات کدنویسی شرکت میکرد، اونهایی رو ترجیح میداد که روی مسائل کوتاهتر با راهحلهای مشخص تمرکز داشتن. اما دمبیاک مسائل طولانیتر و باز رو دوست داشت که جواب درست مشخصی نداشتن.

پاچوکی به یاد آورد: «اون من رو مسخره میکرد و میگفت نوع مسابقاتی که من دوست دارم خیلی زودتر از اونهایی که خودش دوست داره، خودکارسازی میشن. برای همین من به طور جدی پیگیر عملکرد این مدل در آخرین مسابقه بودم.»

پاچوکی گفت که تا دیروقت پای پخش زنده مسابقه از توکیو نشسته بود و میدید که مدلش دوم میشه: «سایکو فعلا مقاومت میکنه.»

چن گفت: «ما مدتیه که عملکرد مدلهای زبان بزرگ رو در مسابقات کدنویسی دنبال میکنیم. ما دیدیم که اونها از من بهتر شدن، از یاکوب بهتر شدن. حسی شبیه بازی لی سدول در برابر آلفاگو داره.»

لی، استاد بازی «گو» است که در سال ۲۰۱۶ در یک سری مسابقه به مدل بازیکننده دیپمایند به اسم آلفاگو باخت. این نتایج جامعه بینالمللی گو رو شوکه کرد و باعث شد لی بازی حرفهای رو کنار بذاره. سال گذشته اون به نیویورک تایمز گفت: «باختن به هوش مصنوعی، به نوعی به معنی فروپاشی تمام دنیای من بود… من دیگه نمیتونستم از بازی لذت ببرم.» و با این حال، بر خلاف لی، چن و پاچوکی از اینکه مدلهاشون از اونها پیشی بگیرن هیجانزدهان.

اما چرا بقیه ما باید به این پیروزیهای تخصصی اهمیت بدیم؟ واضحه که این فناوری، که برای تقلید و در نهایت جایگزینی هوش انسانی طراحی شده، توسط آدمهایی ساخته میشه که ایده اونها از اوج هوش، برنده شدن در یک مسابقه ریاضی یا رقابت شانه به شانه با یک کدنویس افسانهایه. آیا این مشکلسازه که این دیدگاه به هوش، به سمت بخش ریاضیاتی و تحلیلی طیف متمایل شده؟

چن گفت: «منظورم اینه که فکر میکنم حق با شماست که، خب، ما خودخواهانه میخوایم مدلهایی بسازیم که به خودمون سرعت بدن. ما این رو یک عامل خیلی سریع برای پیشرفت میبینیم.»

استدلال پژوهشگرانی مثل چن و پاچوکی اینه که ریاضیات و کدنویسی، زیربنای یک شکل بسیار عمومیتر از هوشه، شکلی که میتونه طیف وسیعی از مسائل رو به روشهایی حل کنه که شاید خودمون بهشون فکر نکرده باشیم. پاچوکی گفت: «ما اینجا داریم در مورد برنامهنویسی و ریاضیات صحبت میکنیم. اما این واقعا در مورد خلاقیت، رسیدن به ایدههای نو و اتصال ایدهها از جاهای مختلفه.»

به دو مسابقه اخیر نگاه کنید: «در هر دو مورد، مسائلی وجود داشت که نیاز به تفکر بسیار سخت و خارج از چارچوب داشت. سایکو نصف مسابقه برنامهنویسی رو به فکر کردن گذروند و بعد به راهحلی رسید که واقعا نو و کاملا متفاوت از هر چیزی بود که مدل ما بررسی کرده بود.»

پاچوکی ادامه داد: «این واقعا چیزیه که ما دنبالشیم. چطور مدلها رو به کشف این نوع بینشهای جدید برسونیم؟ تا واقعا دانش ما رو پیشرفت بدن؟ من فکر میکنم اونها در حال حاضر به شکل محدودی قادر به این کار هستن. اما فکر میکنم این فناوری پتانسیل این رو داره که واقعا پیشرفت علمی رو تسریع کنه.»

سوال دوباره به این موضوع برگشت که آیا تمرکز بر ریاضیات و برنامهنویسی مشکلسازه، با این فرض که شاید اگر چیزی که میسازیم ابزارهایی برای کمک به ما در علم باشه، مشکلی نیست. و این پیشنهاد مطرح شد که ما لزوما نمیخوایم مدلهای زبان بزرگ جایگزین سیاستمداران بشن و مهارتهای اجتماعی داشته باشن.

چن قیافهاش رو در هم کشید و به سقف نگاه کرد: «چرا که نه؟»

چیزی که کمه

OpenAI با سطحی از غرور تاسیس شد که حتی در استانداردهای سیلیکون ولی هم به چشم میومد و از هدفش برای ساختن هوش مصنوعی عمومی (AGI) حرف میزد، اون هم زمانی که صحبت از AGI هنوز عجیب و غریب به نظر میرسید. OpenAI هنوز هم مثل همیشه در مورد AGI مشتاقه و بیشتر از هر شرکت دیگهای باعث شده AGI به یک دغدغه اصلی چند میلیارد دلاری تبدیل بشه. با این حال، هنوز به اونجا نرسیده. از چن و پاچوکی سوال شد که فکر میکنن چه چیزی کمه.

پاچوکی گفت: «فکر میکنم راه تصور آینده اینه که فناوریای که امروز میبینیم رو واقعا عمیق مطالعه کنیم. از اول، OpenAI به یادگیری عمیق به عنوان یک فناوری بسیار مرموز و به وضوح بسیار قدرتمند با پتانسیل زیاد نگاه کرده. ما سعی داشتیم گلوگاههاش رو بفهمیم. چه کاری میتونه انجام بده؟ چه کاری نمیتونه انجام بده؟»

چن گفت که در لبه تکنولوژی فعلی، مدلهای استدلالی قرار دارن که مسائل رو به قدمهای کوچکتر و قابل مدیریتتر تقسیم میکنن، اما حتی اونها هم محدودیت دارن: «میدونید، شما این مدلها رو دارید که چیزهای زیادی میدونن اما نمیتونن این دانش رو به هم زنجیر کنن. چرا اینطوره؟ چرا نمیتونه این کار رو به روشی که انسانها انجام میدن، انجام بده؟»

OpenAI داره با تمام توان برای پاسخ به این سوال تلاش میکنه.

پاچوکی گفت: «ما احتمالا هنوز، مثلا، در همون ابتدای این پارادایم استدلال هستیم. واقعا، ما داریم به این فکر میکنیم که چطور این مدلها رو وادار کنیم در بلندمدت یاد بگیرن و کاوش کنن و واقعا ایدههای بسیار جدیدی ارائه بدن.»

چن روی این نکته تاکید کرد: «من واقعا استدلال رو یک مسئله حلشده نمیدونم. ما قطعا اون رو حل نکردیم. شما باید متنهای خیلی زیادی رو بخونید تا به یک نوع تقریب از چیزی که انسانها میدونن برسید.»

OpenAI نمیگه از چه دادههایی برای آموزش مدلهاش استفاده میکنه یا جزئیاتی در مورد اندازه و ساختارشون نمیده، فقط میگه که داره سخت کار میکنه تا تمام مراحل فرایند توسعه رو بهینهتر کنه.

این تلاشها اونها رو مطمئن کرده که به اصطلاح «قوانین مقیاسپذیری» (scaling laws)، که میگن مدلها با افزایش توان محاسباتی بهتر میشن، هیچ نشانهای از شکستن از خودشون نشون نمیدن.

چن اصرار کرد: «من فکر نمیکنم هیچ مدرکی وجود داشته باشه که قوانین مقیاسپذیری به هر شکلی مرده باشن. همیشه گلوگاههایی وجود داشته، درسته؟ گاهی اوقات به نحوه ساخت مدلها مربوط میشن. گاهی اوقات به دادهها مربوط میشن. اما اساسا فقط باید پژوهشی رو پیدا کنی که شما رو از گلوگاه فعلی عبور بده.»

ایمان به پیشرفت تزلزلناپذیره. به چیزی که پاچوکی در مصاحبه با مجله نیچر در ماه می در مورد AGI گفته بود، اشاره شد: «وقتی من در سال ۲۰۱۷ به OpenAI پیوستم، هنوز جزو بزرگترین شکاکان شرکت بودم.» اون با تردید نگاه کرد.

اون گفت: «مطمئن نیستم که در مورد خود مفهوم شک داشتم. اما فکر میکنم من…» مکث کرد و به دستهاش روی میز نگاه کرد. «وقتی به OpenAI پیوستم، انتظار داشتم جدول زمانی برای رسیدن به نقطهای که الان هستیم، طولانیتر باشه.»

اون گفت: «هوش مصنوعی پیامدهای زیادی داره. اما اونی که من بیشتر از همه بهش فکر میکنم، پژوهش خودکاره. وقتی به تاریخ بشر نگاه میکنیم، بخش زیادی از اون در مورد پیشرفت فناوری و ساخت فناوریهای جدیده. نقطهای که کامپیوترها خودشون بتونن فناوریهای جدید رو توسعه بدن، به نظر یک، امم، نقطه عطف بسیار مهم میاد.»

«ما همین الان هم میبینیم که این مدلها به دانشمندان کمک میکنن. اما وقتی بتونن در افقهای زمانی طولانیتری کار کنن، وقتی بتونن برنامههای پژوهشی برای خودشون تعریف کنن، دنیا به شکل معناداری متفاوت احساس خواهد شد.»

برای چن، این توانایی مدلها برای کار کردن به تنهایی برای مدت طولانیتر، کلیدی است. اون گفت: «منظورم اینه که فکر میکنم هر کسی تعریف خودش رو از AGI داره. اما این مفهوم «زمان مستقل» (autonomous time)، یعنی مقدار زمانی که مدل میتونه برای پیشرفت مفید روی یک مسئله سخت صرف کنه بدون اینکه به بنبست بخوره، یکی از بزرگترین چیزهاییه که ما دنبالشیم.»

این یک دیدگاه جسورانه است و خیلی فراتر از تواناییهای مدلهای امروزیه. اما با این حال، جالب بود که چن و پاچوکی چطور کاری کردن که AGI تقریبا عادی به نظر برسه. این رو با پاسخی که سوتسکور ۱۸ ماه پیش داده بود مقایسه کنید. اون گفته بود: «این موضوع، عظیم و زمینلرزان خواهد بود. یک قبل و یک بعد وجود خواهد داشت.» سوتسکور با مواجهه با عظمت چیزی که میساخت، تمرکز حرفهایش رو از طراحی مدلهای بهتر و بهتر به این سمت تغییر داد که بفهمه چطور فناوریای رو کنترل کنه که معتقد بود به زودی از خودش باهوشتر خواهد شد.

دو سال پیش، سوتسکور تیمی رو به اسم «ابرهمراستاسازی» (superalignment) تاسیس کرد که قرار بود با یک پژوهشگر ایمنی دیگه OpenAI به اسم یان لایکه، مشترکا رهبریش کنه. ادعا این بود که این تیم یک پنجم کامل از منابع OpenAI رو برای فهمیدن چگونگی کنترل یک ابرهوش فرضی اختصاص میده. امروز، بیشتر افراد تیم ابرهمراستاسازی، از جمله سوتسکور و لایکه، شرکت رو ترک کردن و این تیم دیگه وجود نداره.

وقتی لایکه استعفا داد، گفت دلیلش این بوده که تیم، حمایتی که حس میکرد شایستهاش هست رو دریافت نکرده بود. اون در شبکه اجتماعی ایکس نوشت: «ساختن ماشینهای باهوشتر از انسان یک کار ذاتا خطرناکه. OpenAI مسئولیت بزرگی رو از طرف تمام بشریت به دوش میکشه. اما در طول سالهای گذشته، فرهنگ و فرایندهای ایمنی در برابر محصولات پر زرق و برق در اولویت دوم قرار گرفتن.» پژوهشگران دیگهای هم که شرکت رو ترک کردن، بیانیههای مشابهی منتشر کردن.

از چن و پاچوکی سوال شد که نظرشون در مورد این نگرانیها چیه. چن گفت: «خیلی از این چیزها تصمیمات کاملا شخصی هستن. میدونید، یک پژوهشگر میتونه، میدونید…»

دوباره شروع کرد: «اونها ممکنه این باور رو داشته باشن که این حوزه قراره به شکل خاصی تکامل پیدا کنه و پژوهش اونها نتیجه بده و به ثمر بشینه. و، میدونید، شاید شرکت به اون شکلی که شما میخواید تغییر نکنه. این یک حوزه بسیار پویاست.»

اون تکرار کرد: «خیلی از این چیزها تصمیمات شخصی هستن. گاهی اوقات این حوزه داره به شکلی تکامل پیدا میکنه که با روشی که شما پژوهش میکنید کمتر سازگاره.»

اما هر دوی اونها اصرار دارن که همراستاسازی (alignment) حالا بخشی از کسب و کار اصلیه، نه دغدغه یک تیم خاص. به گفته پاچوکی، این مدلها اصلا کار نمیکنن مگر اینکه اونطور که شما ازشون انتظار دارید کار کنن. همچنین تمایل کمی برای تمرکز روی همراستاسازی یک ابرهوش فرضی با اهداف شما وجود داره، وقتی که انجام این کار با مدلهای موجود به اندازه کافی چالشبرانگیزه.

پاچوکی گفت: «دو سال پیش، ریسکهایی که ما تصور میکردیم بیشتر ریسکهای نظری بودن. دنیای امروز خیلی متفاوت به نظر میرسه و من فکر میکنم خیلی از مشکلات همراستاسازی الان انگیزههای خیلی عملی دارن.»

با این حال، فناوری آزمایشی سریعتر از همیشه در حال تبدیل شدن به محصولات بازاری و عمومیه. آیا این واقعا هیچ وقت منجر به اختلاف نظر بین این دو نفر نمیشه؟

پاچوکی گفت: «من اغلب این شانس رو دارم که واقعا به بلندمدت و مسیری که فناوری داره میره فکر کنم. دست و پنجه نرم کردن با واقعیت این فرایند، هم از نظر افراد و هم از نظر نیازهای گستردهتر شرکت، بر عهده مارک میفته. این واقعا یک اختلاف نظر نیست، اما یک تنش طبیعی بین این اهداف مختلف و چالشهای متفاوتی که شرکت باهاشون روبروئه، بین ما شکل میگیره.»

چن پرید وسط حرفش: «من فکر میکنم این فقط یک تعادل بسیار ظریفه.»

منابع

- [۱] The two people shaping the future of OpenAI’s research | MIT Technology Review

دیدگاهتان را بنویسید