خلاصه

- متا مدل DINOv3 رو معرفی کرده که با یادگیری خودنظارتی، تصاویر رو بدون نیاز به برچسب میفهمه و یه پیشرفت بزرگه.

- این مدل، ۱.۷ میلیارد تصویر رو بدون نیاز به نظارت انسان آموزش دیده و ۷ میلیارد پارامتر داره.

- DINOv3 تو تشخیص اشیا و بخشبندی معنایی، حتی از مدلهای تخصصیتر هم بهتر عمل میکنه و نیاز به تنظیم دقیق نداره.

- کاربردهای واقعیش خیلی زیاده؛ مثلاً WRI ازش برای نظارت بر جنگلزدایی و ناسا برای رباتهای مریخنوردش استفاده میکنه.

- این مدل حتی به مغز انسان هم شبیه شده؛ هرچی مدل بزرگتر و روی دادههای انسانیتر آموزش ببینه، بیشتر شبیه مغز عمل میکنه.

- متا DINOv3 رو اوپن سورس منتشر کرده و حتی نسخههای کوچکتر و بهینهتری رو هم برای نیازهای مختلف ارائه داده.

- با DINOv3 میشه با یه مدل واحد، چندین ماهواره و تصاویر پهپادی رو تحلیل کرد، که هزینه و زمان رو خیلی کم میکنه.

- این فناوری به خیریهها کمک میکنه با کمترین هزینه، پروژههای احیای جنگل رو نظارت کنن و مطمئن بشن بودجهها درست خرج میشه.

دنیای هوش مصنوعی، مخصوصا مدلهای زبانی بزرگ، با یک ایده کلیدی به اینجا رسیده: یادگیری خودنظارتی یا Self-supervised learning (SSL). یعنی مدلها میتوانند بدون نظارت مستقیم انسان و به صورت مستقل یاد بگیرند. این روش در مدلهای زبانی که با حجم عظیمی از متون اینترنت آموزش میبینند، حسابی جواب داده. اما در حوزه بینایی کامپیوتر یا همون درک تصاویر، ماجرا کمی عقبتر بود. بهترین مدلهای پردازش تصویر هنوز هم به شدت به متادیتایی که انسانها تولید میکنند، مثل کپشنهای زیر عکسها در وب، وابسته بودند.

حالا، متا با معرفی DINOv3 این بازی را عوض کرده. DINOv3 یک مدل بینایی کامپیوتر عمومی و پیشرفته است که با همین روش SSL آموزش دیده و میتواند ویژگیهای بصری با وضوح بالا تولید کند. برای اولین بار، یک «بکبون» (backbone) یا ستون فقرات بینایی واحد و «فریز شده» (frozen) – یعنی مدلی که بعد از آموزش اولیه دیگر تغییر نمیکند – توانسته در کارهای پیچیدهای مثل تشخیص اشیا و بخشبندی معنایی (semantic segmentation) از راهکارهای تخصصی هم بهتر عمل کند.

موفقیت DINOv3 به خاطر تکنیکهای نوآورانه در SSL است که نیاز به دادههای برچسبخورده را کاملا از بین میبرد. این موضوع زمان و منابع لازم برای آموزش را به شدت کاهش میدهد و به متا اجازه داده تا حجم دادههای آموزشی را به ۱.۷ میلیارد تصویر و اندازه مدل را به ۷ میلیارد پارامتر برساند. این رویکرد بدون برچسب، درهایی را به روی کاربردهایی باز میکند که در آنها برچسبگذاری کمیاب، گران یا حتی غیرممکن است. برای مثال، تحقیقات نشان داده که بکبونهای DINOv3 که روی تصاویر ماهوارهای آموزش دیدهاند، در کارهایی مثل تخمین ارتفاع پوشش گیاهی، عملکرد فوقالعادهای دارند.

انتظار میرود DINOv3 نه تنها کاربردهای فعلی را سریعتر کند، بلکه کاربردهای جدیدی را هم ممکن سازد و باعث پیشرفت در صنایعی مثل بهداشت و درمان، نظارت بر محیط زیست، خودروهای خودران، خردهفروشی و تولید شود و درک بصری دقیقتر و کارآمدتری را در مقیاس بزرگ فراهم کند.

متا DINOv3 را با مجموعهای کامل از بکبونهای اوپن سورس تحت یک لایسنس تجاری منتشر کرده، که شامل یک بکبون ماهوارهای آموزشدیده روی تصاویر MAXAR هم میشود. همچنین بخشی از کدهای ارزیابی هم به اشتراک گذاشته شده تا جامعه بتواند نتایج را بازتولید کرده و بر اساس آن کارهای جدیدی انجام دهد. نوتبوکهای نمونه هم ارائه شده تا مستندات دقیقی برای شروع کار با DINOv3 در دسترس همه باشد.

دستاوردهای یادگیری خودنظارتی در عمل

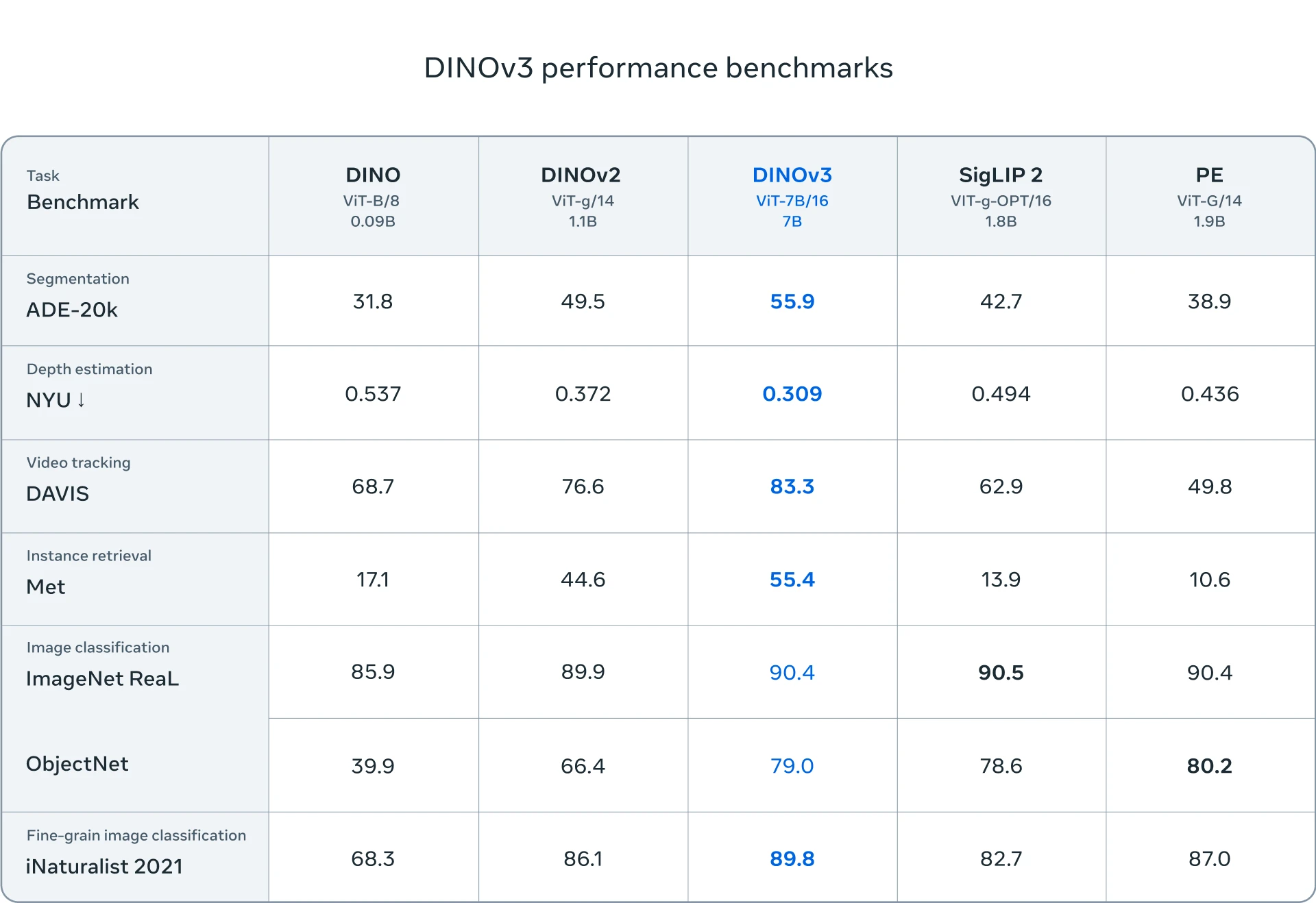

DINOv3 یک نقطه عطف جدید به حساب میآید، چون برای اولین بار نشان میدهد که مدلهای SSL میتوانند در طیف وسیعی از وظایف، از همتایان خود که با نظارت ضعیف (weakly supervised) آموزش دیدهاند، بهتر عمل کنند. در حالی که مدلهای قبلی DINO در کارهای «پیشبینی متراکم» (dense prediction) مثل بخشبندی و تخمین عمق تکچشمی پیشتاز بودند، DINOv3 از آنها هم فراتر رفته. این مدلها در بسیاری از بنچمارکهای طبقهبندی تصویر، با قویترین مدلهای اخیر مثل SigLIP 2 و Perception Encoder برابری میکنند یا حتی از آنها بهتر هستند و همزمان، فاصله عملکرد خود را در کارهای پیشبینی متراکم به شدت افزایش میدهند.

DINOv3 بر اساس الگوریتم موفق DINO ساخته شده که نیازی به ورودی متادیتا ندارد، در مقایسه با روشهای قبلی فقط کسری از توان محاسباتی را برای آموزش مصرف میکند و همچنان مدلهای پایه بینایی فوقالعاده قدرتمندی ارائه میدهد. بهبودهای جدیدی که در DINOv3 معرفی شده، باعث شده این مدل در کارهای رقابتی مثل تشخیص اشیا، حتی با محدودیت شدید «وزنهای فریز شده» (frozen weights)، به عملکردی پیشرفته دست پیدا کند. این ویژگی محققان و توسعهدهندگان را از تنظیم دقیق (fine-tuning) مدل برای کارهای خاص بینیاز میکند و کاربرد گستردهتر و کارآمدتری را ممکن میسازد.

از آنجایی که رویکرد DINO به طور خاص برای هیچ نوع تصویر خاصی طراحی نشده، همین الگوریتم را میتوان فراتر از تصاویر وب، در حوزههای دیگری که برچسبگذاری در آنها بسیار دشوار یا گران است، به کار برد. DINOv2 پیش از این هم با استفاده از حجم عظیمی از دادههای بدون برچسب، به کارهای تشخیصی و تحقیقاتی در بافتشناسی، آندوسکوپی و تصویربرداری پزشکی کمک کرده بود. در تصاویر ماهوارهای و هوایی هم حجم و پیچیدگی بسیار زیاد دادهها، برچسبگذاری دستی را غیرعملی میکند. با DINOv3، این امکان فراهم شده که از این مجموعه دادههای غنی برای آموزش یک بکبون واحد استفاده شود که بعدا میتوان آن را برای انواع مختلف ماهوارهها به کار برد و کاربردهای عمومی در نظارت بر محیط زیست، برنامهریزی شهری و واکنش به بلایای طبیعی را ممکن ساخت.

تاثیر DINOv3 در دنیای واقعی: از جنگلها تا مریخ

DINOv3 همین الان هم در حال ایجاد تاثیر در دنیای واقعی است. موسسه منابع جهانی (WRI) از این مدل جدید برای نظارت بر جنگلزدایی و حمایت از احیای جنگلها استفاده میکند تا به گروههای محلی در حفاظت از اکوسیستمهای آسیبپذیر کمک کند. WRI با استفاده از DINOv3 تصاویر ماهوارهای را تحلیل کرده و از بین رفتن درختان و تغییر کاربری زمین را در اکوسیستمهای تحت تاثیر، تشخیص میدهد. افزایش دقتی که از DINOv3 به دست آمده، به خودکارسازی پرداختهای مالی مرتبط با آب و هوا از طریق تایید نتایج احیا کمک میکند، هزینههای تراکنش را کاهش میدهد و سرعت رسیدن بودجه به گروههای کوچک و محلی را بیشتر میکند.

برای مثال، در مقایسه با DINOv2، مدل DINOv3 که روی تصاویر ماهوارهای و هوایی آموزش دیده، میانگین خطا در اندازهگیری ارتفاع پوشش درختی در منطقهای در کنیا را از ۴.۱ متر به ۱.۲ متر کاهش داده است. حالا WRI میتواند حمایت از هزاران کشاورز و پروژه حفاظتی را با کارایی بیشتری مقیاسپذیر کند.

آزمایشگاه پیشرانش جت ناسا (JPL) هم از قبل از DINOv2 برای ساخت رباتهای کاوشگر مریخ استفاده میکرد تا چندین کار بینایی را با حداقل محاسبات ممکن انجام دهد. این نشان میدهد که تطبیقپذیری و کارایی این خانواده از مدلها چقدر برای کاربردهای حیاتی و با منابع محدود مناسب است.

مقیاسپذیری و کارایی بدون نیاز به تنظیم دقیق

DINOv3 با آموزش یک مدل ۷ برابر بزرگتر روی یک مجموعه داده ۱۲ برابر بزرگتر نسبت به DINOv2 ساخته شده است. برای نشان دادن تطبیقپذیری این مدل، آن را روی ۱۵ کار بصری متنوع و بیش از ۶۰ بنچمارک ارزیابی کردهاند. بکبون DINOv3 به خصوص در تمام کارهای پیشبینی متراکم میدرخشد و درک استثنایی از طرحبندی صحنه و فیزیک زیربنایی آن را نشان میدهد.

ویژگیهای غنی و متراکم این مدل، مشخصات قابل اندازهگیری هر پیکسل در یک تصویر را به صورت بردارهایی از اعداد اعشاری ثبت میکنند. این ویژگیها میتوانند اشیا را به اجزای ریزتر تقسیم کنند و حتی این درک را به نمونهها و دستهبندیهای مختلف تعمیم دهند. این قدرت نمایش متراکم باعث میشود که بتوان آداپتورهای سبکی را با حداقل برچسبگذاری روی DINOv3 آموزش داد. یعنی فقط چند برچسب و یک مدل خطی کافی است تا به پیشبینیهای متراکم و قابل اعتمادی برسیم. حتی با استفاده از یک دیکدر پیچیدهتر، میتوان بدون نیاز به تنظیم دقیق بکبون، در کارهای اصلی و قدیمی بینایی کامپیوتر به عملکردی پیشرفته دست یافت. نتایج این رویکرد در تشخیص اشیا، بخشبندی معنایی و تخمین عمق نسبی نشان داده شده است.

چون میتوان بدون تنظیم دقیق بکبون به نتایج پیشرفته رسید، یک بار اجرای مدل (forward pass) میتواند به طور همزمان به چندین کاربرد سرویس دهد. این باعث میشود هزینه استنتاج بکبون بین کارهای مختلف تقسیم شود، که به خصوص برای کاربردهای «لبه» (edge applications) که اغلب نیاز به اجرای همزمان چندین پیشبینی دارند، حیاتی است.

مقیاسپذیری DINOv3 تا ۷ میلیارد پارامتر، پتانسیل کامل SSL را نشان میدهد. اما یک مدل ۷ میلیاردی برای بسیاری از کاربردها عملی نیست. به همین دلیل و با توجه به بازخورد جامعه، خانوادهای از مدلها با اندازههای مختلف ساخته شده تا نیازهای محاسباتی متفاوت را پوشش دهد. با «تقطیر» (distilling) مدل ViT-7B به نسخههای کوچکتر و با عملکرد بالا مثل ViT-B و ViT-L، مدل DINOv3 در مجموعهای از ارزیابیها از مدلهای مشابه مبتنی بر CLIP بهتر عمل میکند. علاوه بر این، معماریهای جایگزین ConvNeXt (در نسخههای T، S، B، L) که از ViT-7B تقطیر شدهاند نیز معرفی شده تا با محدودیتهای محاسباتی مختلف سازگار باشند. متا همچنین خط لوله تقطیر خود را منتشر کرده تا جامعه بتواند بر اساس آن مدلهای جدیدی بسازد.

همکاری با موسسه منابع جهانی (WRI) برای احیای جنگلها

برای بیش از یک دهه، موسسه منابع جهانی (WRI) با همکاری کسبوکارهای محلی، سازمانهای دولتی و دیگر نهادهای غیرانتفاعی برای حفاظت و احیای جنگلها، زمینهای کشاورزی و سایر اکوسیستمها تلاش کرده است. شفافیت، هسته اصلی این کار است. بدون دادههای بسیار دقیق، مرتبط با هر منطقه و کمهزینه، غیرممکن است که بفهمیم آیا میلیاردها دلاری که برای حفاظت از محیط زیست سرمایهگذاری میشود، تاثیر ملموسی روی زمین دارد یا نه.

از سال ۲۰۱۴، WRI پلتفرم نظارت بر جنگلهای جهانی، Global Forest Watch، را اداره میکند که تغییرات جنگلها و کاربری زمین را با استفاده از دادههای ماهوارهای در دسترس عموم ردیابی میکند. آخرین تحلیل آنها نگرانکننده بود: جنگلهای اولیه استوایی در سال ۲۰۲۴ با سرعتی معادل ۱۸ زمین فوتبال در هر دقیقه ناپدید شدهاند.

در گام بعدی، محققان متا و WRI با تکیه بر همکاری طولانیمدت خود، از مدل DINOv2 برای نقشهبرداری از ارتفاع پوشش درختی جهان با جزئیاتی بیسابقه استفاده کردند تا دقت مجموعه دادههای آینده را بهبود بخشند. چالش بعدی، به کار بردن این تکنولوژی برای نظارت بر پروژههای محلی احیای جنگل و کشاورزی جنگلی (agroforestry) بود. WRI با همکاری One Tree Planted و Realize Impact، صندوق TerraFund را ایجاد کرد تا دهها پروژه کوچک در آفریقا را که به رشد مجدد جنگلها و احیای مزارع کمک میکنند، تامین مالی کند. این پروژه در سال ۲۰۲۲ با بودجه اولیه از طرف صندوق زمین بزوس (Bezos Earth Fund) و حمایت متا راهاندازی شد.

مجموعه دادههای موجود میتوانستند ناپدید شدن درختان بزرگ را تشخیص دهند، اما نظارت بر درختان تازه در حال رشد بسیار سختتر است، چون زمان زیادی طول میکشد تا آنقدر بلند شوند که از فضا دیده شوند. شرکای این صندوق به راهحلهای مقیاسپذیر و کمهزینه نیاز داشتند تا بتوانند بفهمند کدام پروژهها در بین هزاران سایت پروژه در ۲۷ کشور آفریقایی موثرتر هستند. این یعنی آنها باید میتوانستند نهالهای کوچک را از زمان رشد، شمارش و نظارت کنند.

جان برانت (John Brandt)، مدیر علم داده برای احیا در WRI و آزمایشگاه زمین و کربن (Land & Carbon Lab)، با همکاری متا از DINOv3 برای توسعه الگوریتمی استفاده کرد که میتواند درختان را به صورت تکی از روی تصاویر پهپادی و ماهوارهای با دقت بشمارد. برانت از تصاویر ماهوارهای با وضوح بالا استفاده کرد و مدل را با نگاه کردن به مرزهای جغرافیایی پروژههای TerraFund آموزش داد. نتایج اولیه شگفتانگیز است. محققان میتوانند یک نهال در حال رشد را تنها ۸ ماه پس از کاشته شدن ببینند و به نظارت بر آن ادامه دهند. با مقایسه دادههای خوداظهاری پروژههای محلی با نتایج الگوریتم، WRI میتواند تایید کند که کدام پروژهها به اهداف خود میرسند و آنها را برای دریافت بودجه بیشتر توصیه کند.

به گفته برانت، کار با چنین مدل اوپن سورس جهانی که از قبل روی حجم زیادی از دادههای ماهوارهای آموزش دیده، به WRI اجازه میدهد تا به راحتی مدل را برای نیازهای خود تطبیق دهد، که این کاملا با ارزشهای اصلی WRI یعنی مشارکت و تاثیر جمعی هماهنگ است. آزمایشگاه زمین و کربن WRI، فراتر از ردیابی رشد درختان، از این مدل برای آزمایش تکنیکهای نظارتی و برنامهریزی کاربری زمین مقیاسپذیر و کمهزینه برای همه انواع پوشش زمین و اکوسیستمها استفاده خواهد کرد. این مدل قبلا هم توانایی آنها را برای پیادهسازی مدلها در کارهای مختلف رصد زمین تسریع کرده و باعث افزایش کارایی و کاهش هزینهها شده است.

به طور سنتی، برای هر ماهواره یک مدل سفارشی ساخته میشد. WRI که از شش ماهواره مختلف برای کارهای رصدی گوناگون استفاده میکرد، با چالش ساخت و تنظیم مدلهای جداگانه برای هر کدام روبرو بود که نیاز به آمادهسازی دادههای آموزشی و بهینهسازی پارامترهای زیادی داشت. در حالی که DINOv2 هدفش ارائه یک مدل جهانی برای تصاویر بود، DINOv3 این ایده را به طور قابل توجهی بهبود بخشید و تحلیل دادهها را در چندین ماهواره و تصاویر پهپادی بدون نیاز به ساخت مدل سفارشی ممکن کرد.

برانت میگوید: «DINOv3 به ما این امکان را میدهد که تمام رویکردهای مدلسازی خود را از طریق یک خط لوله واحد یکپارچه کنیم و در عین حال به دقت بالاتری در نظارت بر پروژههای احیا با اطمینان بیشتر دست پیدا کنیم».

امیلی آورنا (Emily Averna) از صندوق زمین بزوس میگوید: «ابزارهای اوپن سورس مانند DINOv3 به شفافیت و پاسخگویی در احیا کمک میکنند. ما از کمک به ابزارهای نوآورانهای که به تلاشهای احیا در سراسر جهان وضوح و سرعت میبخشند، هیجانزدهایم». او اضافه میکند: «از آنجایی که DINOv3 به صورت عمومی در دسترس است، یک سازمان غیردولتی محلی در روستایی در کنیا اکنون میتواند با یک لپتاپ و فقط ۱۰ دلار اعتبار ابری، نقشههای با وضوح بالا از بازیابی جنگل تولید کند. برای خیریهها، این کار احیا را از یک اقدام مبتنی بر ایمان به چیزی تبدیل میکند که میتوانیم ببینیم، اندازهگیری کنیم و به آن اعتماد کنیم تا دستاوردهای کربنی و طبیعی که سیاره ما به شدت به آن نیاز دارد را ارائه دهد».

WRI با مرتبط کردن ۶۱ میلیون دلار سرمایهگذاری در کشورهای آفریقایی، برزیل و هند با این تکنیکها، نشان میدهد که حتی بهبودهای جزئی در دقت میتواند حجم این تراکنشها را افزایش دهد. این به رسیدن منابع مالی به سازمانهای کوچکتر کمک میکند. برانت میگوید: «ما واقعا از توانایی داشتن مدلی به اندازه کافی قوی برای پشتیبانی از تراکنشهای مالی بزرگتر در بازار آب و هوا هیجانزدهایم».

نگاهی عمیقتر به جنبههای فنی DINOv3

یک گزارش فنی که توسط تیمی از محققان متا از جمله Oriane Siméoni، Huy V. Vo، Maximilian Seitzer و دیگران منتشر شده، جزئیات بیشتری از DINOv3 ارائه میدهد. این گزارش توضیح میدهد که یادگیری خودنظارتی پتانسیل حذف نیاز به برچسبگذاری دستی دادهها را دارد و به مدلها اجازه میدهد تا به راحتی به مجموعه دادههای عظیم و معماریهای بزرگتر مقیاس پیدا کنند. با این روش، میتوان از منابع متنوعی، از تصاویر طبیعی گرفته تا هوایی، با یک الگوریتم واحد، نمایشهای بصری را یاد گرفت.

این گزارش، DINOv3 را یک نقطه عطف بزرگ در این مسیر معرفی میکند که با استفاده از استراتژیهای ساده اما موثر به دست آمده است:

- مقیاسپذیری: با آمادهسازی دقیق دادهها، طراحی و بهینهسازی، از مزایای مقیاسپذیری همزمان مجموعه داده و اندازه مدل استفاده شده است.

- روش Gram anchoring: یک روش جدید به نام «Gram anchoring» معرفی شده که به طور موثر مشکل شناختهشده اما حلنشده افت کیفیت نقشههای ویژگی متراکم (dense feature maps) در طول آموزشهای طولانی را برطرف میکند.

- استراتژیهای پس از آموزش: از استراتژیهای پس از آموزش برای افزایش انعطافپذیری مدلها از نظر وضوح تصویر، اندازه مدل و هماهنگی با متن استفاده شده است.

در نتیجه، یک مدل پایه بینایی همهکاره ارائه شده که بدون نیاز به تنظیم دقیق، در طیف وسیعی از تنظیمات از بهترین مدلهای تخصصی هم بهتر عمل میکند.

| ویژگی | DINO/DINOv2 | DINOv3 (جدید) |

|---|---|---|

| داده آموزشی | تا ۱۴۲ میلیون تصویر | ۱.۷ میلیارد تصویر |

| پارامترها | تا ۱.۱ میلیارد | ۷ میلیارد |

| تنظیم دقیق بکبون | نیاز ندارد | نیاز ندارد |

| وظایف پیشبینی متراکم | عملکرد قوی | از مدلهای تخصصی بهتر عمل میکند |

| نسخههای مدل | ViT-S/B/L/g | ViT-B/L/G, ConvNeXt |

| انتشار | اوپن سورس | لایسنس تجاری، بسته کامل |

شباهت DINOv3 به مغز انسان

یک تحقیق جالب دیگر که توسط Josephine Raugel، Marc Szafraniec، Huy V. Vo و دیگران انجام شده، به این سوال پرداخته که چه عواملی باعث میشود مدلهای هوش مصنوعی، نمایشهایی شبیه به مغز انسان ایجاد کنند. برای این کار، آنها خانوادهای از مدلهای DINOv3 را آموزش دادند که در آنها معماری مدل، روش آموزش و نوع داده به طور سیستماتیک تغییر کرده بود.

سپس نمایشهای این مدلها از تصاویر طبیعی را با فعالیت مغز انسان که با fMRI (تصویربرداری تشدید مغناطیسی کارکردی) و MEG (مغناطیسنگاری مغزی) ثبت شده بود، مقایسه کردند. آنها دریافتند که هر سه عامل – اندازه مدل، میزان آموزش و نوع تصویر – به طور مستقل و تعاملی بر شباهت مدل به مغز تاثیر میگذارند. به طور خاص، بزرگترین مدلهای DINOv3 که با بیشترین مقدار تصاویر انسانمحور آموزش دیده بودند، بالاترین امتیاز شباهت به مغز را کسب کردند.

نکته مهم این است که ظهور این نمایشهای شبهمغزی در مدلهای هوش مصنوعی یک ترتیب زمانی خاصی را در طول آموزش دنبال میکند:

- مدلها ابتدا با نمایشهای اولیه قشر حسی مغز هماهنگ میشوند.

- فقط با دادههای آموزشی بسیار بیشتر است که با نمایشهای پیچیدهتر و پیشانی مغز هماهنگ میشوند.

این مسیر رشدی با ویژگیهای ساختاری و عملکردی قشر مغز انسان مرتبط است: نمایشهایی که مدلها دیرتر یاد میگیرند، به طور خاص با نواحی از قشر مغز هماهنگ هستند که بیشترین گسترش رشدی، بیشترین ضخامت، کمترین میلین و کندترین مقیاسهای زمانی را دارند. این یافتهها به درک اینکه چگونه شبکههای عصبی مصنوعی دنیا را مانند انسانها میبینند، کمک میکند.

تحقیقات مرتبط دیگر

- افزایش سرعت استنتاج: در مقالهای از تیمهای GenAI و Infra، به بهینهسازی تکنیکهای آموزش و استنتاج برای فعال کردن «رمزگشایی گمانهزنانه» (speculative decoding) مبتنی بر EAGLE در مقیاس تولید برای مدلهای Llama پرداخته شده است. این تغییرات باعث شده تا سرعت استنتاج مدل Llama4 Maverick به حدود ۴ میلیثانیه برای هر توکن (با بچ سایز یک) روی ۸ پردازنده گرافیکی NVIDIA H100 برسد که ۱۰ درصد سریعتر از بهترین روش قبلی است.

- مجموعه داده کریستالهای مولکولی: برای رفع کمبود مجموعه دادههای عمومی در زمینه ساختار و خواص کریستالهای مولکولی، مجموعه داده Open Molecular Crystals 2025 (OMC25) معرفی شده که شامل بیش از ۲۷ میلیون ساختار کریستال مولکولی است. این مجموعه داده برای تسریع توسعه مدلهای یادگیری ماشین دقیقتر برای کریستالهای مولکولی در دسترس عموم قرار گرفته است.

- پیشبینی ساختار کریستالی: یک گردش کار اوپن سورس و با توان بالا به نام FastCSP معرفی شده که بر اساس پتانسیلهای بین اتمی یادگیری ماشین (MLIPs) کار میکند. این ابزار میتواند نتایج پیشبینی ساختار کریستالی را برای یک سیستم در عرض چند ساعت روی دهها پردازنده گرافیکی مدرن به دست آورد و دسترسی به این حوزه را آسانتر کند.

دیدگاهتان را بنویسید